AI 개발 시대, DevSecOps가 기본값인 이유

최근 LLM의 가파른 발전 속도에 힘입어 소프트웨어 개발은 그 어느 때보다 빨라지고, 릴리즈 주기도 짧아졌습니다. 이에 발맞춰 AI 생성 코드 보안의 중요성도 더욱 높아졌는데요. AI에 기반한 빠른 개발 속도만큼이나, 정확하고 효율적으로 작동하며, 보안을 철통같이 지키는 솔루션 니즈도 커지고 있죠. DevSecOps는 그 해답으로 다시 주목받고 있습니다. 이 글에서는 AI 개발 환경에서 DevSecOps의 필요성, AI 기반 DevSecOps의 코드 보안 강화 방식과 주요 솔루션, AI와 DevSecOps 통합 시 유의 사항을 살펴보겠습니다.

AI 개발 환경에서 DevSecOps의 필요성

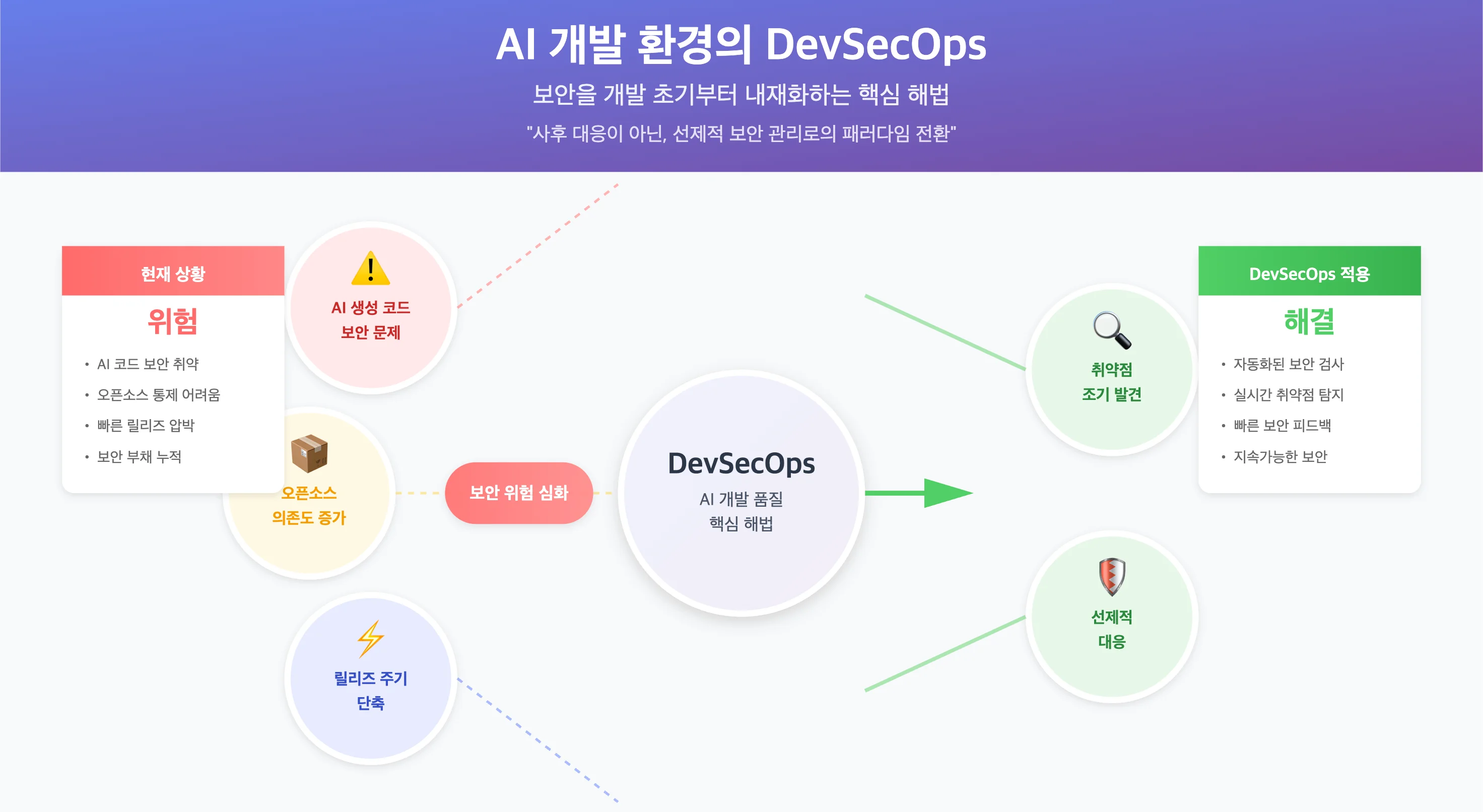

오늘날 DevSecOps는 AI 개발의 품질을 높이는 핵심 해법으로 주목받고 있습니다. 그 배경에는 AI 생성 코드의 보안 문제가 있는데요. 오픈 소스 코드 의존도 증가와 소프트웨어 릴리즈 주기 단축이 더해지면서 보안 위험은 심화하고 있죠. DevSecOps는 보안을 사후 대응이 아닌, ‘개발 초기부터 내재화해야 할 요소’로 다루는데요. 이러한 원칙에 따라 AI 생성 코드의 보안 취약점을 조기에 발견하고, 선제적으로 대응할 수 있습니다. 지금부터 AI 개발 환경에서 DevSecOps가 필요한 이유와 그 가치를 알아보겠습니다.

AI 생성 코드의 보안 문제 지속

가장 큰 이유는 여전히 지속되는 AI 생성 코드의 보안 문제입니다. 글로벌 보안 기업 Snyk의 ‘2023 Snyk AI-Generated Code Security Report’에 따르면, 응답자 91.6%가 “AI 코딩 도구가 안전하지 않은 코드 제안을 가끔 생성했다”고 답했죠. 글로벌 보안·신흥 기술 싱크탱크인 CSET의 2024년 보고서에서도 비슷한 조사 결과를 발표했습니다. 연구진의 평가 결과, 5개의 LLM이 생성한 코드 스니펫의 절반 가까이가 치명적인 버그를 포함했고요. 이는 악의적 악용으로 이어질 수 있어 심각했습니다.

올해도 상황은 개선되지 않고 있습니다. 글로벌 보안 기업인 Veracode는 “2025 GenAI Code Security Report”에서 Java, Python, C#, JavaScript에 100개 이상의 LLM을 테스트한 결과를 공유했는데요. AI 생성 코드 샘플의 45%가 보안 테스트에 실패했고, 코드에 OWASP* Top 10에 해당하는 보안 취약점을 유발한 걸로 나타났습니다. LLM이 테스트의 45%에서 보안 취약점을 일으켰다는 의미죠. 가장 흔한 보안 취약점은 ‘크로스-사이트 스크립팅’이었는데요. 관련 코드 샘플의 86%에서 AI 도구가 이를 방어하지 못했습니다.

*OWASP: 웹 애플리케이션 보안 분야의 글로벌 비영리 단체

오픈 소스 코드 의존도 상승

소프트웨어 개발에서 오픈 소스 코드 의존도 증가도 DevSecOps의 필요성을 높입니다. Snyk에 따르면, 애플리케이션 코드 구성의 80~90%가 오픈 소스로 추정되는데요. 의존도가 높아질수록 개발자가 오픈 소스 코드의 품질과 보안을 제어하기 어려울 수 있죠. 오픈 소스 소프트웨어 라이브러리인 Log4j의 취약점 ‘Log4Shell’을 예로 살펴보겠습니다. Log4Shell은 해커가 Log4j의 패치되지 않은 버전을 실행하는 장치에 완전한 제어 권한을 갖도록 합니다. 이로써 해커는 취약한 시스템에서 그들이 원하는 코드를 대부분 실행할 수 있죠.

Log4Shell은 발견 직후 패치됐습니다. 그러나 IBM은 “Log4j가 소프트웨어 공급망에 깊숙이 내장돼 Log4Shell이 앞으로 수년간 위험을 초래할 수 있다”고 경고했죠. 오픈 소스 코드의 잠재적 보안 위협을 보여주는 사례입니다. 이 문제는 AI 생성 코드와도 연결되는데요. Veracode에 따르면, 오픈 소스 소프트웨어 유지관리자, 서드 파티 벤더, 로코드/노코드 플랫폼, 백그라운드에서 생성형 AI를 사용하는 외주 계약자도 AI로 코드를 생성합니다. 이는 오픈 소스 코드를 사용하는 개인 또는 조직의 시스템에 유입될 수 있죠. 그중에는 보안 취약점이 있는 코드도 포함될 수 있고요. 오픈 소스 생태계 특성상 AI 생성 코드의 보안 취약점이 널리 확산할 가능성이 있습니다.

잦은 릴리즈 → 보안 부채 증가

소프트웨어 릴리즈 주기 단축도 DevSecOps의 당위성 강화에 한몫합니다. 과거에는 몇 주에 한 번씩 릴리즈했는데요. 요즘은 시간, 일, 주 단위로 릴리즈하죠. 글로벌 IT 리서치 기업인 Techstrong Research의 “DevOps Next: 2024 and Beyond” 보고서에 따르면, 가장 많은 응답자가 ‘신규 코드를 프로덕션에 매주 릴리즈한다’고 답했습니다(34%). 특히 AI로 코드 작성 속도를 높이면서 릴리즈 주기도 더 짧아질 거로 전망되는데요. 이로써 패치와 수정 사항도 신속히 배포해 소프트웨어 품질과 보안은 향상할 거로 예상되죠.

그러나 릴리즈가 잦아지면, 각 릴리즈에 누적되는 보안 부채가 커질 위험도 있습니다. AI로 많은 코드가 빠르게 생성돼 프로덕션에 자주 배포되면, 여기에 포함된 보안 취약점도 잦은 빈도로 광범위하게 퍼질 가능성이 있죠. 사용자는 취약점 영향을 더 빨리 받을 수도 있고요. 글로벌 DevSecOps 기업 DeepSource의 공동 창업자이자 CEO인 Sanket Saurav는 IT 매체 Crunchbase 기고에서 “자동화 도구가 개입해 지속적 배포(CD)를 보호하는 게 중요하다”며 “그렇지 않으면 보안 부채가 취약점 확산으로 이어질 수 있다”고 경고했습니다.

DevSecOps 초기 대응 → 위험 완화

DevSecOps를 적용하면, 강력한 초기 대응으로 AI 생성 코드의 이러한 보안 문제를 미리 파악하고 해결할 수 있습니다. DevSecOps의 목표는 개발 프로세스 전반에 보안을 내재화하는 거죠. 이는 DevOps 워크플로 초반에 보안 제어와 프로세스를 통합해 핵심 보안 작업을 자동화합니다. 성숙한 DevSecOps 파이프라인에서는 자동화된 코딩 → 빌드 → 테스트 → 배포 → 모니터링 단계를 거쳐 취약점을 수 시간 내에 탐지하고 대응할 수 있습니다. 즉, 코드를 merge 하기 전에 취약점을 스캔하고요. 인프라가 프로비저닝되기 전에 정책을 적용하죠. 그 결과, 개발 주기 초반에 보안 위협을 발견하고, 제거할 수 있고요. 개발 속도도 유지할 수 있습니다.

AI 생성 코드에도 이러한 DevSecOps 방식을 적용해 보안을 강화할 수 있습니다. 글로벌 애플리케이션 보안 테스트 솔루션 기업 Checkmarx의 부사장인 Eran Kinsbruner는 다음 방식을 제안합니다. AI 코드에 버전 제어를 적용하고, 모델을 추적하며, CI/CD로 배포가 제어되도록 하고요. 또 AI 시스템을 지원하는 모든 코드, 파이프라인, 인프라를 기존 애플리케이션 보안 도구로 검사합니다. AI 에이전트를 연계하면, 모든 빌드에 정책을 자동 적용하고, 컴플라이언스 상태를 평가하며, 시정 조치를 자동 생성할 수도 있는데요. 이는 보안 취약점 확산과 보안 부채 누적 방지에 도움이 될 수 있습니다.

AI DevSecOps의 코드 보안 강화 방식/솔루션

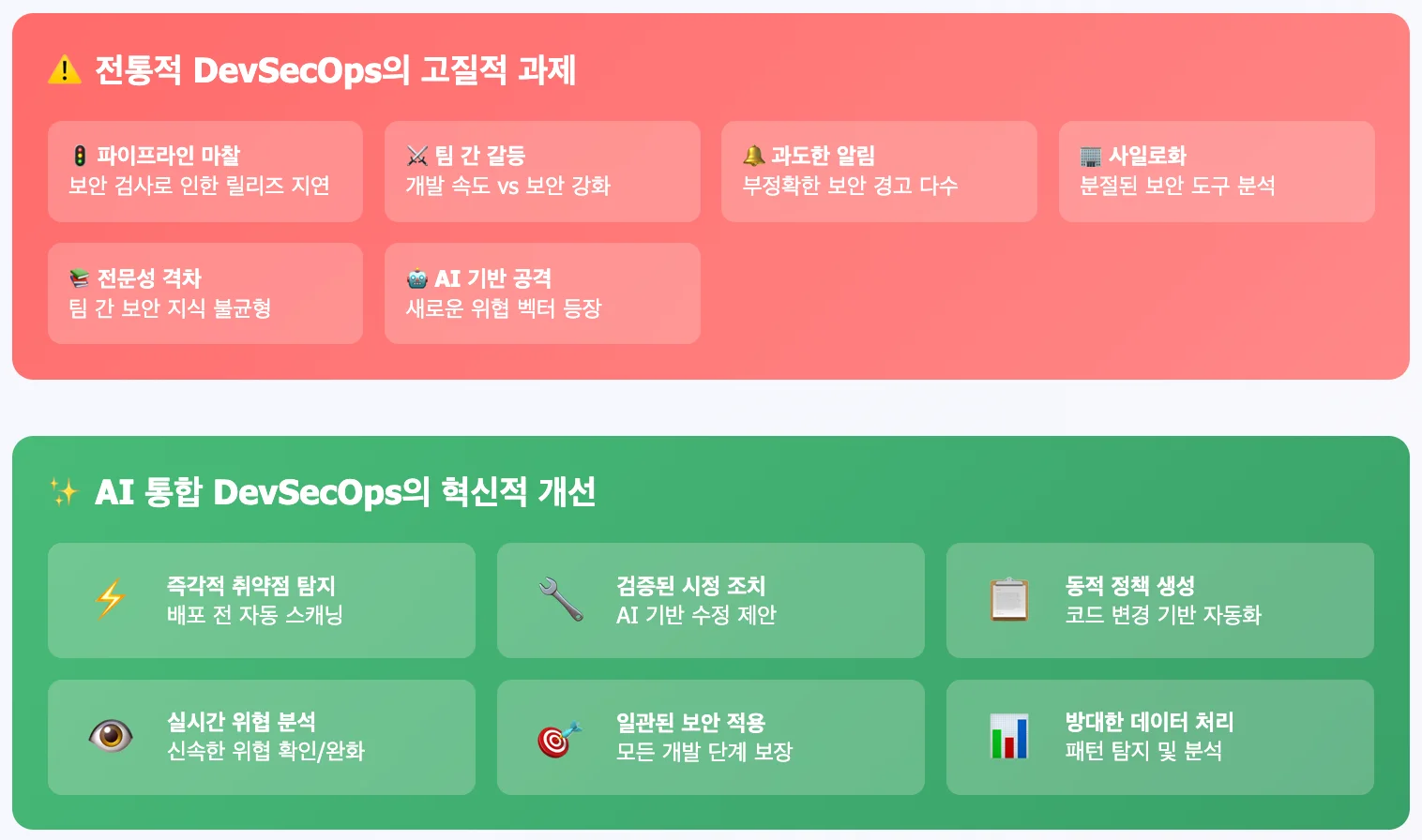

전통적인 DevSecOps 방식만으로는 AI 개발 환경의 보안 요구에 완벽히 대응하기 어렵습니다. Checkmarx는 오늘날 DevSecOps에 다음과 같은 고질적 과제를 지적하는데요. 보안 검사는 CI/CD 파이프라인에 마찰을 일으켜 릴리즈가 늦어지게 하죠. 개발자는 빠른 기능 배포를 우선시하고, 보안 팀은 위험 완화를 우선시하면서 갈등도 생기고요. 보안 도구가 많은 알림을 보내지만, 상당수는 부정확한 알림일 때도 있습니다. 또 보안 도구가 사일로화된 분석을 제공하고요. 팀 간 보안 전문성 격차도 있죠. 요즘은 AI 기반 공격도 발생합니다.

최근 이러한 문제를 개선하기 위해 DevSecOps에 AI를 통합하는 방식이 주목받고 있는데요. AI는 방대한 데이터를 처리하고, 패턴을 탐지하며, 즉각적인 추천을 제공해 AI 생성 코드의 보안을 강화하도록 지원합니다. 보안 스캐닝을 자동화해 배포 전에 취약점을 더 빨리 탐지하고요. 검증된 시정 조치를 제안할 수 있죠. 또 코드 변경 사항에 기반해 보안 정책을 동적으로 생성하고요. 보안 이벤트를 실시간 분석해 위협을 더 신속하고 정확하게 확인하고 완화할 수 있습니다. 이밖에 보안 조치가 모든 개발 단계에 일관되게 적용되도록 보장하고요.

GitLab, Snyk, Codacy 등 플랫폼은 AI 기반 DevSecOps 기능을 도입해 빠르고 지능적으로 AI 생성 코드의 보안 문제를 발견, 해결하도록 지원합니다. AI 어시스턴트와 고도화된 분석 도구로 AI 개발 환경에 민첩하게 대응하도록 돕는데요. 각 사의 관련 도구를 자세히 살펴보겠습니다.

GitLab

GitLab은 AI 기능 모음인 GitLab Duo와 내장 보안 도구로 AI 생성 코드를 포함한 보안 문제에 원활히 대응하도록 돕습니다. 예를 들어, Code Suggestions로 AI에게 코드를 제안받고요. GitLab Duo로 테스트를 생성해 코드 기능을 검증할 수 있죠. 또 AI 어시스턴트인 GitLab Duo Chat으로 코드를 리뷰하고, 취약점을 확인할 수 있습니다.

특히 GitLab Duo는 ‘Vulnerability Explanation’ 기능으로 취약점 설명을 지원하는데요. 이는 취약점을 요약하고, 악용 방식과 수정 방안까지 이해하도록 돕습니다. 아울러 ‘Vulnerability Resolution’ 기능으로 취약점을 해결하는 Merge request를 자동 생성해 대응 속도를 높이죠.

무엇보다 GitLab은 SAST와 Advanced SAST, DAST, 컨테이너 스캐닝, IaC 스캐닝, Fuzz Testing, 컴플라이언스 프레임워크 등 다양한 내장 보안 도구로 개발 단계 전반에서 보안을 체계적으로 관리합니다. 이로써 전통적인 DevSecOps 기반을 견고히 다지며, GitLab Duo의 AI 기능으로 AI 개발 환경에 특화된 보안 대응력을 강화합니다.

Snyk

Snyk는 AI 기반 코드 보안 도구인 Snyk Code를 제공합니다. 이는 실시간 코드 스캐닝과 자동 수정 기능을 지원하는데요. 인기 언어와 IDE, CI/CD 도구와 호환되는 취약점 스캐너도 운영하죠. Snyk의 코드 취약점 탐지 기능은 광범위한 애플리케이션 컨텍스트와 기능을 활용해 불필요한 결과를 제거하고요. 조직에 더 위험하거나, 관련성이 더 높은 신규 코드, 배포된 코드, 공개 노출된 코드 문제를 우선 처리하도록 합니다.

아울러 Snyk Code는 모든 Pull request와 리포지터리를 자동 스캔해 상태 보고서를 생성하고요. 이로써 기존 문제를 평가하고, 우선순위를 정하며, 수정하죠. 또 2500만개 데이터 흐름 케이스가 모델링된 상태에서, 머신러닝 엔진으로 수백만개의 오픈 소스 라이브러리를 탐색하는데요. 이로써 휴먼 인 더 루프* AI가 지식베이스를 탄탄하게 구축하도록 합니다.

*휴먼 인 더 루프(Human-in-the-loop): AI 모델이 완전히 자동으로 의사결정을 내리지 않고, 중요한 단계에서 사람이 개입해 검증·보정·피드백을 수행하는 접근 방식

Codacy

Codacy는 선호하는 IDE와 AI 어시스턴트를 통합해 실시간 보안과 품질 피드백을 제공합니다. AI 코드 분석 기능은 AI 생성 코드에서 자동으로 보안 문제를 탐지하고요. 실시간 피드백 기능은 코딩할 때 바로 피드백을 주는데요. 코드가 커밋되기 전에 문제를 강조 표시해 문제를 조기에 차단하죠. Codacy는 VS Code, Cursor, Windsurf와 통합할 수 있습니다.

이 솔루션은 리포지터리도 자동 분석하는데요. 이로써 모든 코드가 조직의 보안, 품질 기준을 충족하도록 합니다. 아울러 모든 Pull request에 포괄적 검사를 진행하고요. SAST, 의존성 스캐닝, 시크릿 탐지도 수행하죠. 또 코드 품질과 테스트 커버리지, 기술 부채까지 추적하고요. DAST로 실행 중인 애플리케이션을 테스트하면서 취약점을 확인하죠. 이밖에 공격을 시뮬레이션해 보안 취약점을 찾기도 합니다.

AI + DevSecOps 통합 시 유의 사항

AI를 DevSecOps에 통합하면, 보안 문제 해결 속도와 완성도를 높일 수 있습니다. 그러나 최상의 결과를 얻으려면 철저한 사전 준비와 명확한 원칙이 필요합니다. Snyk의 Developer Advocate인 Stephen Thoemmes는 AI와 DevSecOps를 통합할 때 유의 사항을 다음과 같이 제안합니다.

기존 워크플로 평가

AI를 구현하기 전에 기존 워크플로를 먼저 평가합니다. 이는 보안과 컴플라이언스 위험을 미리 해결하기 위함입니다.

명확한 지침 수립

AI 도입의 명확한 지침을 수립합니다. 이는 보안 워크플로에서 AI 역할을 정의하기 위함입니다.

책임감 있는 AI 제공업체 선정

신뢰할 만하고, 책임감 있는 AI 제공업체를 찾습니다. 이러한 업체는 정확성을 개선하고 편향을 최소화하기 위해 모델을 유지 보수하는 곳입니다.

휴먼 인 더 루프 유지

보안을 위해 사람이 AI 추천을 모니터링하도록 휴먼 인 더 루프를 유지합니다. 이로써 안정성과 신뢰성을 보장할 수 있습니다.

AI 도구 난립 방지

AI 기반 보안 솔루션을 통합해 AI 도구 난립(sprawl) 현상을 줄입니다. 이는 불필요한 복잡성과 비용을 피하기 위함입니다.

맺음말

지금까지 AI 개발 환경에서 DevSecOps의 필요성, AI 기반 DevSecOps의 코드 보안 강화 방식과 주요 솔루션, AI와 DevSecOps 통합 시 유의 사항을 알아봤습니다. 이 글의 요점은 다음과 같은데요.

- AI 개발은 AI 생성 코드의 취약점, 오픈 소스 의존도 증가, 잦은 릴리즈에 따른 보안 부채 누적으로 기존보다 더 높은 보안 리스크에 노출됐습니다.

- DevSecOps는 보안을 코딩·빌드·테스트·배포 등 개발 전 과정에 내재화하고 자동화해 취약점을 조기에 발견·차단하며 속도와 품질을 동시에 확보합니다.

- GitLab, Snyk, Codacy 등 AI 기반 도구는 취약점 설명과 자동 수정, 컨텍스트 기반 우선순위 정리로 대응 속도를 높여 보안을 극대화합니다.

- AI와 DevSecOps를 통합할 때는 기존 워크플로 점검, 명확한 지침 수립, 책임감 있는 AI 제공업체 선정, 휴먼 인 더 루프 유지, AI 도구 난립 방지 등 기본 원칙을 지켜야 합니다.

참고 자료

- “2023 Snyk AI-Generated Code Security Report”, Snyk, 2023, https://go.snyk.io/2023-ai-code-security-report-dwn-typ.html?aliId=eyJpIjoiM0dZeUpFSnU4djRmTG01QiIsInQiOiJGeWRPcklPOG5NVUU5TkRqS0tIQjVnPT0ifQ%253D%253D

- Jessica Ji·Jenny Jun·Maggie Wu·Rebecca Gelles, “Cybersecurity Risks of AI-Generated Code”, CSET, 2024-11, https://cset.georgetown.edu/publication/cybersecurity-risks-of-ai-generated-code

- Jens Wessling, “We Asked 100+ AI Models to Write Code. Here’s How Many Failed Security Tests”, Veracode, 2025-07-30, https://www.veracode.com/blog/genai-code-security-report/

- Sanket Saurav, “What Is DevSecOps And Why Does It Matter In The Age Of AI?”, Crunchbase, 2025-04-03, https://news.crunchbase.com/ai/devsecops-value-open-source-security-saurav-deepsource/

- Liran Tal, “SAST vs. SCA testing: What’s the difference? Can they be combined?”, Snyk, https://snyk.io/articles/application-security/sast-vs-sca-testing/

- “What is the Log4j vulnerability?”, IBM, https://www.ibm.com/think/topics/log4j

- Fabbro(박용석), “AI로 생성한 코드 문제점과 유의 사항”, 인포그랩, 2024-07-24, https://insight.infograb.net/blog/2024/07/24/ai-code/

- Grace(박민영), “2023년에 주목할 DevOps 트렌드 5가지”, 인포그랩, 2023-03-27, https://insight.infograb.net/blog/2023/03/27/2023-devops-5/

- Eran Kinsbruner, “DevSecOps Best Practices in the Age of AI”, Checkmarx, https://checkmarx.com/learn/ai-security/devsecops-best-practices-in-the-age-of-ai/

- “The Future of AI in DevSecOps: Advanced and Automated Security”, Checkmarx, 2025-04-04, https://checkmarx.com/blog/the-future-of-ai-in-devsecops-advanced-and-automated-security/

- Vivek Sonar, “AI-Driven DevSecOps: Building Intelligent CI/CD Pipelines”, Aviator, 2024-10-19, https://www.aviator.co/blog/ai-driven-devsecops-building-intelligent-ci-cd-pipelines/#

- David O'Regan, “Developing GitLab Duo: Secure and thoroughly test AI-generated code”, GitLab, 2024-05-30, https://about.gitlab.com/blog/how-gitlab-duo-helps-secure-and-thoroughly-test-ai-generated-code/

- “Vulnerability details”, GitLab, https://docs.gitlab.com/user/application_security/vulnerabilities/

- Fernando Diaz, “Quick vulnerability remediation with GitLab Advanced SAST + Duo AI”, GitLab, 2024-10-22, https://about.gitlab.com/blog/quick-vulnerability-remediation-with-gitlab-advanced-sast-duo-ai/

- Codacy 홈페이지, https://www.codacy.com/, 접속일: 2025년 8월 19일

- Snyk Code 홈페이지, https://snyk.io/product/snyk-code/, 접속일: 2025년 8월 20일

- Stephen Thoemmes, “Leveraging Generative AI with DevSecOps for Enhanced Security”, Snyk, https://snyk.io/articles/leveraging-generative-ai-with-devsecops-for-enhanced-security/

지금 이 기술이 더 궁금하세요? 인포그랩의 DevOps 전문가가 알려드립니다.

사전 동의 없이 2차 가공 및 영리적인 이용을 금하며, 온·오프라인에 무단 전재 또는 유포할 수 없습니다.

DevOps 도입이 필요하신가요?

인포그랩 전문가가 맞춤 을 도와드립니다.

관련 글

AI와 DevSecOps를 안전하게 결합하는 4가지 전략

이 글은 AI를 DevSecOps에 안전하게 통합하기 위해 지켜야 할 4가지 핵심 전략을 다뤘습니다. AI 활용 현황 파악부터 시크릿 관리, 빌드 시스템 보안, 취약점 관리·데이터 검증까지 실무에 적용할 수 있는 모범 관행을 소개합니다.

2025년 10월 1일

AI 에이전트는 보안 취약점 관리를 어떻게 자동화할까?

이 글은 AI 에이전트를 중심으로 보안 취약점 관리 자동화 기술 동향을 다뤘습니다. Claude Code는 자동 보안 리뷰 기능으로 보안 문제 검사와 수정을 지원합니다. Opus Security는 멀티 에이전트 기반 자율형 취약점 관리 플랫폼으로 취약점 분석과 시정 조치를 자동화합니다. Cycode는 AI 악용 가능성 분석으로 고위험 취약점을 신속하게 확인합니다. DeepSource는 완전 자율 에이전트 방식으로 리포지터리를 모니터링하고, 의사결정을 내리며, 적절한 조치를 취합니다.

2025년 9월 3일

Google Opal로 반복 업무 자동화하기

Google의 Opal은 자연어 프롬프트로 AI 애플리케이션을 설계·생성할 수 있는 노코드/로코드 플랫폼입니다. 이는 빠른 프로토타입 제작과 간단한 자동화 시나리오 구현에 유용합니다. 이 글은 Opal의 핵심 원리, 기술 블로그 작성 자동화 예제, DevOps 환경에서 실질적인 활용 방안을 다뤘습니다.

2025년 10월 15일